Challenge IA : Sensibilisation

Dans cette activité, les makers découvrent certains des risques de l’IA, en particuliers ceux liés aux données qu’on leur transmet.

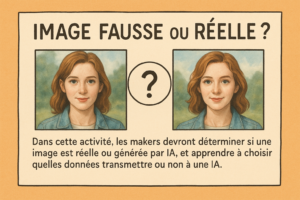

Ils vont se confronter à des images sans savoir si elles sont faites par IA et voir si ils sont capables de faire la différence.

Conseil pour les anims :

A retenir !

- L’initiation (10 min)

- Importance du manque de sécurité de l’IA par rapport aux données

- Le défi (10 min)

- Petit test pour apprendre à reconnaitre une image IA

Déroulé de l'activité

Segmentation de l’activité

- Segment 1 (5 min) : Introduction

- Segment 2 (10 min) : Jeu d’initiation

- Segment 3 (10 min) : Le Duel !

Détail de l’activité

Segment 1 (5 min) : Introduction

Accueille les makers et installe les autour de la table. Fait leur une petite intro en expliquant que l’IA peut se tromper (et même se tromper souvent). Si ses données contiennent des erreurs, ses réponses en contiendront aussi.

La plupart des gens ne se rendent pas compte que l’IA leur dit des bêtises…pourquoi donc?

Segment 2 (10 min) : Les risques des données IA

1/ L’assurance trompeuse

- Glisser dans l’introduction 2 faits divers:

- 1 fait (qui est faux) raconté avec assurance, en mentionnant des études, des noms de scientifiques inventés ou fausses grandes écoles etc.

- 1 fait (qui est vrai) raconté avec un peu d’hésitation, quelques ‘euh’ et 0 ‘sources (ou genre, des sources bizarres genre “j’ai vu sur tiktok”)

Revenez ensuite sur le sujet: Comment savoir si l’IA ment ? On ne peut presque jamais deviner juste en lisant sa réponse, surtout si on ne connais pas le sujet.

Tiens au fait: lesquels des 2 faits qu’on vient d’énoncer est vrai?

Dur à dire hein? (Si vous avez des petits malins qui sentent venir le piège c’est pas grave, on peut tourner ça à notre avantage.)

Révéler lequel était faux et lequel était vrai. Et comment la façon dont vous avez raconté chaque fait à influencé les makers. (si vous avez eu des petits malins, demandez leur à eux d’expliquer comment ils ont sentis venir le piège. Ce qui leur a mit la puce à l’oreille)

La réponse: l’assurance.

Comme pour les réponses d’une IA. Parce que, comme dans notre petit piège, l’IA répond avec assurance, comme si elle ne pouvait pas se tromper, quitte à inventer des sources.

La seule solution pour ne jamais tomber dans le piège: vérifier chaque réponse au crible fin. Le problème ?

Ça prend autant de temps que de chercher sans l’IA… alors à quoi elle sert ?

2/ Les données de l’IA:

Demander aux makers si ils savent comment les IA obtiennent leurs données ? (spoiler : c’est pas très gentil…)

Elles font du scraping sauvage : Des scripts qui vont coper tout ce qu’ils trouvent sur Internet, sans demander:

- Sites gratuits

- sites payants

- réseaux sociaux

etc.

Certains contenus étaient libres de droit (ok quoique), mais beaucoup protégés ou privés (et la c’est du vol)

Hors le truc avec l’utilisation de ces données c’est que de la même façon qu’un élève qui recopie un devoir en changeant 2 mots ≠ un travail original. Et bien une IA qui génère une image ≠ un travail original.

En Europe, on a une loi (GDPR) qui te permet de demander à une entreprise : “Supprimez mes données!”

Elles doivent obéir, sinon elles risquent d’énormes amendes (jusqu’à des millions d’euros !)

On voit aussi de plus en plus de grosses entreprises qui contre-attaquent en justice, en faisant des procès aux companie d’IA:

Disney, DreamWorks etc. attaquent les boîtes d’IA pour vol de leurs films/dessins.

On ne sait pas encore les résultats mais ça pourrait changer les règles pour tout le monde.

Segment 3 (10 min) : Les risques personnels

Sur cette seconde partie, on va discuter des risques personnel de l’IA.

1/ Les risques pour moi

L’IA nous rend stupide. Non ce n’est pas une exagération. A cause d’elle on arrête de réfléchir ce qui fait une “Décharge cognitive” (étude Forbes 2025). En fait le cerveau c’est un muscle, si on ne s’en sert pas, il s’abîme! Et l’IA est programmée pour te flatter, et donc tu t’aperçois moins que tu deviens idiot car l’IA te dit que tu ne l’es pas!

Tu as aussi du danger au niveau de la responsabilité: “C’est pas moi, c’est l’IA qui a dit ça !” : Mais qui a décidé d’utiliser cette IA, et qui est responsable quand elle dit une bêtise? (laisser les makers discuter un peu)

Ta vie privée aussi est en danger. Les conversations avec une IA ne sont pas toujours privées: Vos données peuvent être revendues (a cause des conditions d’utilisation)

On à même des IA qui font du chantage ou des menaces quand on menace de les éteindres!

2 / Le mini-jeu

On va maintenant jouer à un petit jeu: il va falloir trouver lesquels de ces 25 images sont générées par IA:

Laisser les makers jouer, et discuter avec eux en même temps des risques:

- Aujourd’hui, on peut encore repérer certaines images IA (mains bizarres, textures floues, détails inconsistents…)Mais… les IA progressent très vite !

- Déjà des victimes : Personnes âgées, enfants… trompés par des deepfakes.

D’ici 2-3 ans ? Personne ne sera à l’abri. - Désinformation massive: Éducation sabotée : Faux documentaires avec des “preuves scientifiques”